1. INTRODUCCIÓN

En Cundinamarca se encuentra ubicada una de las producciones nacionales de fresas más grandes del país, aprox. 53,1%, seguido por Antioquia con 29,6%, Norte de Santander con 7,9%, Cauca con 6,6%, Boyacá con 1,3% y Valle del Cauca con 0,6%.

Tabla 1. Área cosechada, producción y rendimiento de fresa en Colombia 2011. Anuario Estadístico de frutas y hortalizas (2007-2011). [1]

|

Departamento |

Área cosechada (ha) |

Producción (Tonelada) |

Rendimiento (kg/ha) |

|

Antioquia |

275 |

10.731 |

39.022 |

|

Boyacá |

55 |

734 |

13.345 |

|

Caquetá |

6 |

60 |

10.000 |

|

Cúcuta |

59 |

1.636 |

27.729 |

|

Cundinamarca |

595 |

28.545 |

47.975 |

|

Norte de Santander |

119 |

3.144 |

26.420 |

|

Santander |

5 |

45 |

9.000 |

|

Total |

1.133 |

45.000 |

39.718 |

Colombia es uno de los principales países productores de fresas junto con Estados Unidos, Turquía, España y Egipto, lo que permite ser un cultivo rentable y necesario para el país. [2]

Dadas estas circunstancias de alta producción en los campos del país, se decidió orientar el proyecto a un sistema de adquisición y procesamiento de imágenes, que tiene como objetivo destacar detalles como su color. Esto criterio variara según el mercado, a la hora de la selección de fresas maduras y listas para recolectar. [3]

En la actualidad los robots que son capaces de detectar y clasificar fresas son desarrollos extranjeros y adaptados a otro tipo de cultivos. [4] [5] Por lo tanto, se desea desarrollar soluciones de bajo costo adecuadas para los cultivos de fresas presentes en el país. [6] [7] [8] [9]

El presente artículo presenta el diseño de un algoritmo para la determinación de la madurez de fresas, a partir de un procesamiento de imágenes desarrollado en el lenguaje de programación “Python” con librerías de “OPENCV” e implementado en la Raspberry Pi 2B. [10]

2. MATERIALES Y METODO

2.1. HARDWARE

RASPBERRY PI

Raspberry PI es un computador de bajo costo, desarrollado en el Reino Unido por la Fundación Raspberry Pi (Universidad de Cambridge) en 2011, con el objetivo de estimular la enseñanza de la informática en las escuelas, su comercialización empezó a partir del año 2012. [11]

Está compuesto por varios componentes electrónicos. Adicionalmente, cuenta con una cámara con una resolución máxima de 5 MPx [12]

Fig. 1. “Raspberry Pi 2B y PiCamera”

2.2. SOFTWARE

OPEN CV (Open Source Computer Vision)

Tiene licencia de software para el sistema BSD (Berkeley Software Distribution), es de uso académico y comercial. Tiene interfaces de C ++, C, Python y Java y es compatible con Windows, Linux, Mac OS, iOS y Android. Open CV fue diseñado para la eficiencia computacional y con enfoque en aplicaciones en tiempo real. En su mayor parte es utilizado para la robótica avanzada. [13]

PYTHON

Es un lenguaje de programación de alto nivel, desarrollado a finales del año 1980 en el Instituto Nacional de Investigación de Matemáticas y Ciencias de la Computación por Guido van Rossum. [12]

2.3. PROCESAMIENTO DE IMÁGENES

El procesamiento de imágenes es un conjunto de técnicas que se aplican desde una imagen de origen, para extraer información específica o de interés. [14]

El procesamiento de imágenes consta normalmente de los siguientes pasos: [15]

A. Capturar la imagen:

Se obtiene una imagen de la cámara en la configuración establecida, esta se conoce como la imagen de origen.

B. Preprocesamiento:

Para realizar el procesamiento se utilizan filtros que mejorar la imagen digitalizada, gracias a esta técnica se pueden conseguir los siguientes resultados: Suavizar la imagen, Eliminar ruido, Realzar bordes y detectar bordes [4]

C. Extracción de características

En la imagen pre-procesada se busca determinar el objeto de interés a partir de características discriminativas (contornos, alguna figura en específico, color, etc.).

D. Identificación de objetos

Se busca y localiza en la imagen la etiqueta previamente asignada.

2.4. METODOLOGÍA

Para el desarrollo del proyecto, se construyó una maqueta que se asemejara a un surco (montículo de tierra donde se encuentran las plantas de fresas), debido a que no se podían realizar todas pruebas en un cultivo real.

La elaboración se hizo de la siguiente manera: Con 2 pequeñas materas plásticas se generó el relieve del montículo de tierra, con plástico negro se imitó la textura y color del plástico negro mulch de cultivos agrícolas, mientras la planta se elaboró con hojas y tallos de color verde oscuro y fresas conseguidas en un mercado de frutas y verduras. Por último, las fresas se colgaron de tallos para que cayeran a cierta distancia de la máxima altura del surco.

Fig. 2. “Imagen surco” [16]

Fig. 3. “Maqueta surco”

Luego, se realizó un programa para capturar y guardar imágenes en RGB con la Raspberry Pi 2 y su respectiva cámara, tomadas en diferentes entornos de luz. Para este algoritmo se consideró la distancia de la cámara con respecto al surco y el campo de visión de la cámara (figura 4) con una resolución de 640x480 pixeles, para hacer la relación de longitudes entre pixeles y cm.

Fig. 4. “Mediciones de distancia y alcance de visión de la PiCamera”

A partir de las imágenes guardadas, se decidió implementar un preprocesamiento de brillo, haciendo que el brillo general de todas las imágenes tendiera a un valor establecido. Para calcular el brillo general de la imagen, fue necesario convertir el formato RGB a escala de grises y se hizo uso de la siguiente ecuación:

Donde N y M son las dimensiones de ancho y alto de la imagen respectivamente y P es el valor del pixel ubicado en una posición cartesiana i y j de la imagen. Esta fórmula es una ecuación probabilística que suma todos los valores recorriendo el ancho y la altura de la imagen y lo divide entre la cantidad total de pixeles para encontrar el valor promedio.

Luego, se calculó un valor 𝐵𝑠𝑢𝑚 a partir de la resta del brillo deseado a alcanzar (𝐵𝑑𝑒𝑠) y el brillo obtenido de la imagen a escala de grises 𝐵.

![]()

Para generar la tendencia al valor deseado en la imagen RGB, se necesitó hacer una operación de suma a cada pixel 𝑃(𝑖,𝑗,𝑑) en las 3 dimensiones 𝑑 de la imagen RGB con 𝐵𝑠𝑢𝑚, el cual resultó en un nuevo pixel 𝑃𝐵(𝑖,𝑗,𝑑) ubicado en la misma posición y dimensión. A escala de grises no fue necesario considerar 𝑑, ya que solo contiene 1 dimensión.

![]()

Después de obtener la imagen con el preprocesamiento, se desarrolló en el algoritmo la extracción de características teniendo en cuenta la madurez del fruto por medio del color. Una fresa inmadura tiene un color verde claro distinto al verde oscuro del tallo y hojas, y la parte madura tiene un color rojo que se destaca en su entorno. Entonces se dedujo el estado de madurez, comparando los porcentajes de madurez que poseía fresa.

Los parámetros que se siguieron, fue una clasificación por color que va de 0 a 6 como se observa en la siguiente imagen:

Fig. 5. “Tabla Clasificación Fresas.” [2]

Según las recomendaciones se considera la recolección en la etapa que va entre 3 al 5 debido a que si está muy madura en el tiempo que se gasta en su distribución y venta puede dañarse. Por ende, en el procesamiento de imágenes se estableció un rango 57 % a 85 % del color rojo, correspondiente al área que ocupa la fresa.

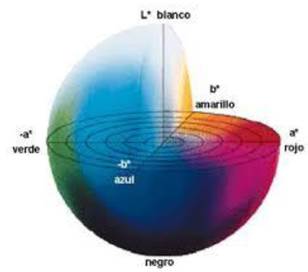

El sistema de color elegido fue el CIE L*A*B*, el cual tiene el control de la luminosidad (blanco y negro) y una separación notable de los colores de interés rojo, verde y amarillo en su estructura como se observa a continuación.

Fig. 6. “Plano Tridimensional del Modelo de Color CIE L *A *B.” [17]

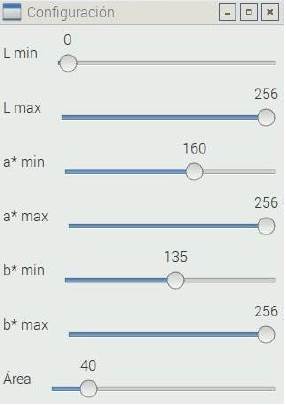

Con la figura que describe el modelo de color CIE L*A*B* y con el diseño de un panel de control con valores de 0 a 256, se escogieron límites de diferencia para cada una de sus dimensiones, ΔL* (claridad), ΔA* (rojo/verde) y ΔB* (amarillo/azul) para encontrar el color de interés. También se le incluyó un control de área para eliminar ruido (objetos de pequeño tamaño).

Fig. 7. “Panel de Control y Pruebas de Color.”

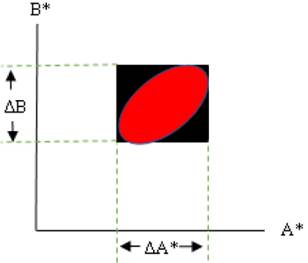

Estos límites crean una caja rectangular de tolerancias donde se encuentra el color a detectar, como se muestra en la figura a continuación.

Fig. 8. “Limites Plano Cartesiano CIE L*A*B*.” [18]

Pero, cuando se compara esta caja de tolerancias con el elipsoide visualmente aceptado, pueden aparecer otros valores no deseados (pixeles color negro). Lo que lleva a que este modelo de color tenga un 75% de concordancia con el aspecto visual real. [18]

En la figura 9 se puede ver la toma de una muestra independiente para generar los parámetros de los valores deseados y en la figura 10 los elipsoides de todo el círculo cromático en los ejes *A y *B.

Fig. 9. “Tolerancia CIE L*A*B*”. [18]

Fig. 10. “Círculo de Colores, Ejes A* y B* CIE L*A*B*.” [18]

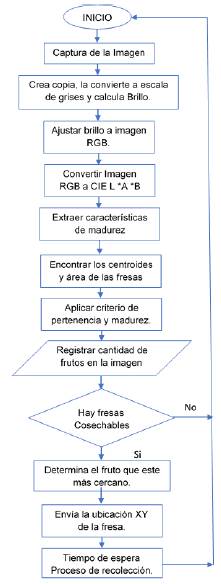

Al tener etiquetadas las partes maduras e inmaduras de las fresas, se realizó la identificación de objetos sacando las áreas y los centroides en coordenadas cartesianas X (horizonte) y Y (altura) de todo. Se compararon simultáneamente las coordenadas X y Y de los centroides, para determinar la parte madura e inmadura que pertenece a cada fresa y la cantidad de frutos que se encuentran en la imagen.

La relación se hizo por medio del radio del círculo más pequeño que encierra a cada objeto y si estos se cruzaban entre ellos. Para este criterio, se tomó en cuenta la ecuación de Pitágoras con las distancias de 2 centroides y de 2 radios (una parte madura y la otra inmadura). Primero se calcula la hipotenusa 𝐻.

![]()

A este resultado se le suma un porcentaje de la hipotenusa (donde 𝐾 es un valor positivo menor a 1) para asegurar un mayor cruce entre ambos objetos y se compara con la suma de ambos radios. Si la suma de los radios es mayor a la hipotenusa resultante, significa que existe un cruce entre el objeto maduro e inmaduro.

![]()

Fig. 11. “Relación entre fresa madura e inmadura”

En la figura 11 se puede observar la relación existente entre la relación de los radios y el objeto maduro e inmaduro. Donde:

R1= Radio 1

R2=Radio 2

H= hipotenusa

Pero también se busca que las coordenadas X entre ambas partes se encuentren en un rango admisible y que sea menor al radio de la sección madura. El proceso busca el color rojo, compara las posiciones X de este con los objetos inmaduros y el primer objeto que cumpla con todos los criterios forma una fresa completa y sigue con el siguiente color rojo detectado. Al final, para evaluar la madurez se calcula el porcentaje de color rojo sobre el área total hallada.

![]()

Donde n es la enumeración para cada fresa encontrada (1, 2, 3, ...). En el caso que una parte madura no tuviera su respectiva parte inmadura, se considera como una fresa no cosechable, debido a que este fruto obtendría un 100% de la madurez y de esta manera, sobrepasaría el parámetro de madurez máximo de 85%. Por último, no se consideran las fresas que no contengan nada de color rojo y estén totalmente inmaduras.

Finalmente, el sistema de embebido con todo el algoritmo fue implementado en un robot móvil recolector de fresas maduras, que se desplazaba y activaba el brazo robótico, basado en los datos de fresas cosechables y su posición adquiridas en el procesamiento de imágenes.

Fig. 12. “Robot Móvil recolector de fresas.”

2.5. DIAGRAMA DE FLUJO (ALGORITMO PROGRAMA)

3. RESULTADOS

En el diseño del programa que permite la identificación del fruto, se realizó una base de datos con imágenes capturadas en diferentes condiciones de iluminación, con el fin de evaluar le detección en diferentes horas del día. Como se puede apreciar en las figuras 12 y 15 al capturar y determinar la madurez como se ha documentado anteriormente, se detectó satisfactoriamente el 100% de las fresas presentes en las 30 imágenes tomadas.

Teniendo en cuenta el periodo en que se pueden recolectar. Al tener fotografías por debajo de los 100 lux, o por encima de los 10000 lux, se aumentó el error de detección de madurez del fruto en un 60%. [19]

Para contrarrestar los cambios de iluminación se aplicó un preprocesamiento, ajustando el nivel de brillo en la imagen tomada. Al implementar dicho cambio se obtuvo una confiabilidad de detección de la madurez del 76,67% de 30 imágenes tomadas se identificaron satisfactoriamente 23.

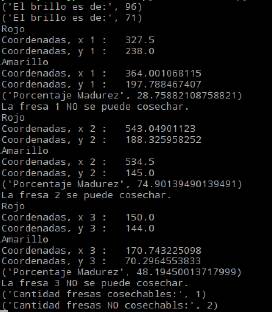

En la figura 14 se pueden observar todos los datos obtenidos en el procesamiento de imágenes que fueron impresos en la pantalla de consola: muestra el cambio de brillo general de un valor de 96 a 71 que se le realizo a la imagen RGB (el valor brillo a alcanzar era de 70), además que entrega toda la información de las fresas que contengan color rojo y su respectiva parte inmadura (Amarillo), el centroide hallado para cada parte madura e inmadura donde el promedio entre ambas generan el centroide de la fresa, indica el porcentaje de madurez e identifica de manera individual y total las fresas cosechables y no cosechables.

En la determinación de la posición XY con respecto a la cámara, se tuvo en cuenta la ubicación establecida con respecto al surco (maqueta realizada) figura 3 donde se encontraba. De acuerdo la posición estimada y la posición que determino el software. Se tiene una tolerancia con respecto al plano XY del 5% con respecto a la ubicación real.

Por último, en las figuras 13 y 16 se muestran los círculos resultantes de cada parte madura (rojo) e inmadura (verde) de las fresas, cuyos radios fueron utilizados para verificar la pertenencia y cumplieron con todos los otros criterios para formar cada una de las fresas completas.

Fig. 13 “Captura de imagen”

Fig. 14. “Identificación del fruto”

Fig. 15. “Información obtenida del Procesamiento de Imágenes.”

Fig. 16. “Captura de Imagen”

Fig. 17. “Identificación del fruto”

4. DISCUSIÓN Y ANÁLISIS DE RESULTADOS

· La cantidad de lúmenes presentes a la hora de tomar la fotografía condiciona drásticamente el rango de operación del algoritmo, ya que se tienen valores fijos que evalúan los colores con el modelo CIE L *A *B. Al cambiar la luz, se cambian los valores de los colores y se puede perder información importante.

· Al implementar un preprocesamiento de brillo a la imagen en el algoritmo de identificación del fruto, se pudo reducir o aumentar ciertos valores en la imagen para mejorar la calidad y rango de los colores. Con esto, se mejoró considerablemente la confiabilidad del algoritmo.

· Existen muchas maneras para hacer el procesamiento de imágenes, el método elegido fue la caracterización por color. En este método existen diversos Modelos de Color, pero gracias a la documentación y consulta a fondo que se hizo, se eligió el modelo CIE L *A *B que separa los colores deseados (rojo, verde/amarillo) y facilita identificarlos.

· El algoritmo presento mayores problemas en la identificación con valores de brillo general drásticos (altos o bajos) en la imagen capturada.

· La madurez de la fresa fue considerada en un plano bidimensional, por lo tanto, cuando se giró la fresa, en ciertos casos, el mismo fruto fue considerado cosechable y no cosechables en diferentes pruebas.

· Se tuvo éxito de localizando fresas maduras a partir del centroide calculado con ejes X y Y y la distancia de fondo Z propuesta entre la cámara y el surco. Donde se validó los resultados obtenidos a partir de la tabla mostrada en el “Manual técnico del cultivo de fresas bajo buenas prácticas agrícolas” [2].

· El manejo del Raspberry Pi 2B con la cámara del mismo fabricante, facilita el procesamiento de imágenes gracias al programa de Open CV y Python, con la gran variedad de comandos que contienen. Además, el sistema de embebido es de pequeño tamaño y bajo costo, lo que facilita la implementación en cualquier proyecto o robot a trabajar.

5. CONCLUSIONES

El horario de operación en el que el software ofrece un alto rendimiento se ve limitado por la cantidad de luz solar al cual está expuesto el fruto. Por tal razón, se propone como trabajo futuro trabajar con un sistema propio de iluminación para asegurar un nivel estándar y monitorear la cantidad de lúmenes en la zona.

El algoritmo implementado con el modelo de color utilizado CIE L *A *B identificó exitosamente las fresas en diferentes ambientes de luz establecidos, sin embargo, la verificación de la madurez se vio afectada. Esto sucede porque se tienen valores fijos para las tolerancias del color al reconocer y se pierde información de interés con los cambios de luz. El color rojo no presenta grandes cambios, pero el color que indica la inmadurez se ve fuertemente afectado.

En el caso de que algún otro elemento cumpla con la condición de color será reconocido como una fresa. Para evitar problemas respecto al reconocimiento se plantea desarrollar un sistema dinámico para la detección de colores y/o implementar nuevos procesos para detectar otras características discriminantes, como por ejemplo la forma.

Al tener un plano bidimensional, no se puede verificar si todo el fruto entero se encuentra madura o no, debido a que la cámara solo puede observar la mitad frontal visible. Adicionalmente, a partir de una imagen no se puede conocer la profundidad. Para solucionar este inconveniente se aseguró una distancia específica entre la cámara y surco.

El procesamiento de imágenes fue de fácil implementación en el robot móvil recolector de fresas, gracias a que el sistema embebido tiene un tamaño reducido y a la comunicación serial que ofrece la Raspberry Pi 2 para conectarse a cualquier otro dispositivo o microcontrolador.

Como trabajo futuro se plantea implementar en el análisis de procesamiento de imagen la detección de enfermedades, por lo cual el sistema de identificación para recolección de fresa será más robusto.

Otra posible característica que se puede implementar es el uso de cámaras infrarrojas, las cuales permitirán realizar la recolección en horas de poca intensidad lumínica. [20]

6. AGRADECIMIENTOS

Le agradecemos por el apoyo en el desarrollo de este trabajo al Semillero de Investigación en Agricultura de Precisión, de la facultad de Ingeniería Mecatrónica, perteneciente a la Universidad Piloto de Colombia.

7. Referencias Bibliográficas

[1] M. d. A. y. d. rural., «Área cosechada, producción y rendimiento de fresa en Colombia 2011.,» de Área cosechada, producción y rendimiento de fresa en Colombia 2011., Colombia, JL Impresores LTDA, 2011, pp. 62-64.

[2] F. Velez, «Manual Técnico del cultivo de fresas bajo buenas prácticas agrícolas,» de Manual Técnico del cultivo de fresas bajo buenas prácticas agrícolas, Medellín, 2014, pp. 12-23.

[3] D. MALACARA, «PROCESAMIENTO DE IMÁGENES,» [En línea]. Available: http://bibliotecadigital.ilce.edu.mx/sites/ciencia/volumen2/ciencia3/084/htm/sec_9.htm. [Último acceso: 12 10 2016].

[4] Wired, «WIRED,» 31 12 2012. [En línea]. Available: https://www.wired.com/2012/08/st_strawberry_robot/. [Último acceso: 11 10 2016].

[5] «Gary Wishnatzki, Co-Founder of Harvest CROO and Owner of Wish Farms, Discusses the Latest on Patent Pending Strawberry Robot,» Press & Editorial, 7 8 2015. [En línea]. Available: http://www.andnowuknow.com/quick-dish/gary-wishnatzki-co-founder-harvest-croo-and-owner-wish-farms-discusses/jordan-okumura/46501#.WX2Oy4ThCpq. [Último acceso: 11 10 2016].

[6] Tsushima-naka, «Faculty of Agriculture,» 2005. [En línea]. Available: http://mama.agr.okayama-u.ac.jp/english/robot03.html. [Último acceso: 12 10 2016].

[7] F. Qingchun, W. Xiu, Z. Wengang y Q. Q. J. K. , «A new strawberry harvesting robot for elevated-trough culture,» Int J Agric & Biol Eng, vol. 5, nº 2, pp. 2-4, 2012.

[8] FresFruitPortal, «U.S.: Robotic strawberry harvester 'mimics human behavior,» 2015. [En línea]. Available: https://www.freshfruitportal.com/news/2015/04/21/u-s-robotic-strawberry-harvester-mimics-human-behavior/. [Último acceso: 12 10 2016].

9] P. RAJENDRA, N. KONDO, K. NINOMIYA y J. KAMATA, «Machine Vision Algorithm for Robots to Harvest Strawberries in Tabletop Culture Greenhouses,» EAEF Research Paper, pp. 25-29, 2009.

[10] T. Hornyak, «$50,000 strawberry-picking robot to go on sale in Japan,» Cnet, p. 1, 27 9 2013.

[11] J. M. Cruz y A. Lutenberg, «SASE 2012,» Simposio Argentino de Sistemas Embebidos, 2012. [En línea]. Available: http://www.sase.com.ar/2012/files/2012/09/Introduccion_a_los_Sistemas_Embebidos-SASE_2012.pdf. [Último acceso: 1 10 2016].

[12]

E. H. G. Upton, «RASPBERRY PI FOUNDATION,» 2017. [En línea]. Available: https://www.raspberrypi.org/forums/viewtopic.php?t=77879. [Último acceso: 15 9 2016].

[13] OpenCV, «OpenCV,» OpenCV team, 2017. [En línea]. Available: http://www.opencv.org/. [Último acceso: 12 10 2016].

[14] T. Pinto y J. Wilber, «Analisís y Diseño de un sistema computarizado para la interpretación colorimétrica y morfomértrica del Chenopodium,» de Analisís y Diseño de un sistema computarizado para la interpretación colorimétrica y morfomértrica del Chenopodium, Perú, 2014, pp. 1-7.

[15] R. Wainschenker, J. M. Massa y P. Tristan, «Procesamiento Digital de Imágnes,» 2011. [En línea]. Available: http://www.exa.unicen.edu.ar/catedras/pdi/FILES/TE/CP1.pdf. [Último acceso: 12 10 2016].

[16] «El cultivo orgánico,» 2015. [En línea]. Available: http://3.bp.blogspot.com/-xnbaN_FIE-E/VOeOpsfepdI/AAAAAAAANw0/alkjFv-s-MI/s1600/siembra%2Bde%2BFresa%2B(2).jpg. [Último acceso: 31 07 2017].

[17] G. Pascualetti, R. Romano, L. García y H. Manzano, «Diferenciación Varietal por Medio del Espacio CIELab simplificado,» Instituto Nacional de Vitivinicultura (INV), pp. 1-5.

[18] X-Rite, «Entender la comunicación del color,» 2002. [En línea]. Available: http://www.mcolorcontrol.com/archivos/L10-001_Understand_Color_es.pdf. [Último acceso: 21 10 2016].

[19] L. Jaramillo, «Iluminación natural en el espacio interior de viviendas,» de Iluminación natural en el espacio interior de viviendas, Ecuador, Universidad del Azuay, 2012, pp. 28-30.

[20] G. Feng, C. Qixin y N. Masateru, «Fruit Detachment and Classification Method for Strawberry Harvesting Robot,» de Fruit Detachment and Classification Method for Strawberry Harvesting Robot, Tokyo, Japan, pp. 42-46.